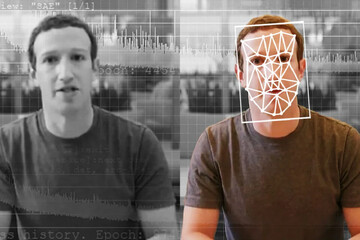

جعل عمیق

-

تولید ویدئوی هوش مصنوعی در عرض یک پلک زدن

ویدئوی هوش مصنوعی آنی و در لحظه از راه رسیده و فرصتها و تهدیدهای جدیدی با خود به همراه آورده است.

-

مراقب تهدید «جعل عمیق» باشید

در آغاز سال میلادی جاری، ویدیویی در سایتهای رسانههای اجتماعی هند منتشر شد که مدیر اجرایی بورس بمبئی، ساندارارامان رامامورتی، را در حال ارائه مشاوره به سرمایهگذاران در مورد خرید سهام نشان میداد. تنها مشکل این بود که رامامورتی در حال صحبت نبود. این یک ویدئوی جعل عمیق از او بود که با استفاده از هوش مصنوعی ساخته شده بود.

-

افزایش ۹۰۰ درصدی استفاده از جعل عمیق در سال

تشخیص واقعیت از جعل عمیق دیگر ممکن نیست

در طول سال ۲۰۲۵، جعل عمیق بهطرز چشمگیری پیشرفت کرد. چهرهها، صداها و حتی اجراهای تمامقد تولیدشده با هوش مصنوعی که افراد واقعی را شبیهسازی میکنند، از نظر کیفیت فراتر از چیزی رفتند که حتی بسیاری از کارشناسان چند سال پیش انتظارش را داشتند. در عین حال، استفاده از آنها برای فریب دادن مردم نیز بهطور محسوسی افزایش یافت.

-

هوش مصنوعی جدید یوتیوب با «جعل عمیق» مبارزه میکند

در عرصه همواره در حال تکامل تولید محتوا، جعلهای عمیق تولید شده توسط هوش مصنوعی، تهدیدی جدی برای سازندگان و بینندگان محسوب میشوند. برای کمک به مهار این مشکل، یوتیوب ابزار جدیدی به نام تشخیص شباهت راهاندازی کرده است.

-

ترامپ امروز «جعل عمیق» را جرم اعلام میکند

دونالد ترامپ، رئیس جمهور آمریکا امروز قانونی موسوم به «Take It »Down را امضا خواهد کرد که استفاده از فناوری «جعل عمیق» یا «دیپفیک» به وسیله هوش مصنوعی را جرمانگاری میکند.