به گزارش ایسنا، خبرآنلاین نوشت: در دنیایی که فناوری هوش مصنوعی (AI) با سرعت سرسامآوری در حال پیشرفت است، توانایی تشخیص تصاویر واقعی از تصاویر تولیدشده توسط هوش مصنوعی به چالشی حیاتی تبدیل شده است. زمانی که تصویری از پاپ با یک کاپشن پفی بزرگ وایرال شد، جهان با واقعیتی نگرانکننده روبهرو شد: دیگر نمیتوانیم به آنچه میبینیم کاملاً اعتماد کنیم.

از تصاویر خندهدار و عجیب اولیه تا محتوای باورپذیر امروزی، ابزارهای هوش مصنوعی مولد مانند DALL-E ۳، Stable Diffusion، و Midjourney تصاویری خلق میکنند که در نگاه اول، و حتی در بررسیهای دقیقتر، میتوانند ما را فریب دهند. این گزارش تفصیلی به بررسی روشهای شناسایی تصاویر تولیدشده توسط هوش مصنوعی، چالشهای مرتبط، و پیامدهای اجتماعی آن میپردازد و راهکارهای عملی برای تقویت مهارتهای تشخیص ارائه میدهد.

انقلاب در خلق تصاویر

قدرت و خطر هوش مصنوعی ابزارهای هوش مصنوعی مولد که تصاویر را از توضیحات متنی تولید میکنند، به لطف دسترسی آسان و هزینه کم یا رایگان، در دسترس همگان قرار گرفتهاند.

ابزارهایی مانند Google Gemini، Adobe Firefly، و Craiyon به کاربران اجازه میدهند ایدههای ذهنی خود را به تصاویری خیرهکننده تبدیل کنند که زمانی تنها از طریق عکاسی یا نقاشی ممکن بود. اما این قدرت خلاقانه با خطراتی همراه است. تصاویر جعلی میتوانند برای پروپاگاندای سیاسی، تولید محتوای غیراخلاقی مانند دیپفیکهای پورنوگرافیک، یا حتی فریب عمومی در اخبار استفاده شوند. با پیشرفت هوش مصنوعی، تشخیص این تصاویر سختتر شده و وعدههایی مانند واترمارکگذاری تصاویر تولیدشده هنوز به نتیجه نرسیده و به نظر میرسد در برابر دستکاریهای عمدی ناکارآمد باشند.

چرا تشخیص تصاویر جعلی اهمیت دارد؟

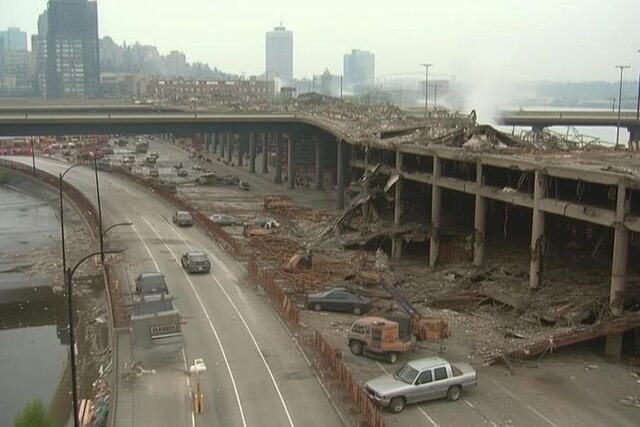

پیامدهای ناتوانی در تشخیص تصاویر تولیدشده توسط هوش مصنوعی فراتر از یک شوخی ساده است. برای مثال، تصاویر جعلی زلزله خیالی کاسکادیا در سال ۲۰۰۱ که از یک سابردیت Midjourney منتشر شد، نشان داد که چگونه یک داستان مصنوعی، با جادههای فرو ریخته، امدادگران، و مردم وحشتزده، میتواند بهسرعت بهعنوان واقعیت پذیرفته شود.

این رویداد خیالی، که تنها در ذهن یک هوش مصنوعی شکل گرفته بود، برای کسانی که تحقیق نکردند واقعی به نظر آمد. چنین مواردی خطر اطلاعات نادرست را در شبکههای اجتماعی و حتی رسانههای خبری برجسته میکند، جایی که تصاویر جعلی میتوانند اعتماد عمومی را تضعیف کنند.

روشهای تشخیص تصاویر تولیدشده توسط هوش مصنوعی

با وجود چالشها، نشانهها و تکنیکهایی وجود دارند که میتوانند به شناسایی تصاویر تولیدشده توسط هوش مصنوعی کمک کنند. این روشها، اگرچه کامل نیستند، ابزارهایی قدرتمند برای تقویت حس تشخیص کاربران ارائه میدهند. در ادامه، چهار روش کلیدی بررسی میشود که ترکیبی از تحلیل بصری و ابزارهای دیجیتال را در بر میگیرند:

۱. جستوجوی معکوس تصویر: ردیابی منبع

یکی از اولین قدمها برای ارزیابی اعتبار یک تصویر، انجام جستوجوی معکوس تصویر است. ابزارهایی مانند Google Reverse Image Search میتوانند منبع یک تصویر را شناسایی کنند یا نشان دهند که آیا مشابه آن در جاهای دیگر وجود دارد. این روش بهویژه برای تصاویر خبری یا آنهایی که در شبکههای اجتماعی وایرال شدهاند مفید است. اگر تصویری ادعای یک رویداد مهم را دارد اما تنها در منابع غیرمعتبر یافت میشود، احتمال جعلی بودن آن بالاست.

مثال زلزله کاسکادیا نشاندهنده قدرت و محدودیت این روش است. جستوجوی معکوس ممکن است تصویری را به یک خبر ظاهراً معتبر از NBC News مرتبط کند، اما بررسی دقیقتر نشان میدهد که هوش مصنوعی از آثار یک عکاس خبری الگوبرداری کرده است. این نشان میدهد که جستوجوی معکوس باید با تحلیل انتقادی همراه باشد تا از فریب خوردن جلوگیری شود.

۲. شکار ناهنجاریها: زوم بر جزئیات

هوش مصنوعی تصاویر خود را با ترکیب بخشهایی از دادههای آموزشی میسازد، که گاهی منجر به ناهنجاریهای ظریف میشود. برای تشخیص این ناهنجاریها، کاربران باید تصویر را با دقت و با زوم حداکثری بررسی کنند. پیکسلهای سرگردان، خطوط عجیب، یا اشکال نادرست در این حالت آشکارتر میشوند.

برای مثال، تصویری از یک موزه شلوغ که توسط Stability AI ساخته شده، در نگاه اول واقعی به نظر میرسد. اما با زوم کردن روی جمعیت، میبینیم که افراد ترکیبی غیرطبیعی از ویژگیها هستند، چهرهها و بدنهایی که انگار از قطعات مختلف سرهم شدهاند. این ناهنجاریها نشانهای از دخالت هوش مصنوعیاند که در بررسیهای سطحی دیده نمیشوند.

۳. پوست بیشازحد صاف: کمال غیرواقعی

یکی از نقاط ضعف رایج هوش مصنوعی، ناتوانی در بازتولید بافتهای طبیعی پوست، مانند منافذ یا نواقص، است. تصاویری که بیشازحد صاف و بیعیب به نظر میرسند، اغلب مصنوعیاند.

تشخیص این ویژگی در دنیای پر از فیلترهای دیجیتال سختتر شده، اما تفاوتهای ظریفی مانند نورپردازی غیرطبیعی یا فقدان بُعد در تصاویر مصنوعی میتوانند سرنخ های مهمی باشند.

۴. بررسی جزئیات ناسازگار: تطبیق اشیا و اندامها

بررسی نزدیک تصاویر میتواند ناسازگاریهای آشکاری را نشان دهد، مانند گوشوارههایی که با هم جور نیستند یا تعداد غیرعادی اندامها.

این تصاویر، با وجود ظاهر واقعی در نگاه اول، پر از ناهنجاریهایی مانند دندانها و انگشتان بیشازحد هستند که حس وهمآلودی به آنها میدهد این ناهنجاریها، که گاهی با الهام از سبکهای هنری غیرواقعی مانند نقاشیهای جان کورین به نظر میرسند، نشانههای واضحی از دخالت هوش مصنوعیاند.

چالشهای تشخیص و محدودیتها

با وجود این روشها، تشخیص تصاویر تولیدشده توسط هوش مصنوعی همچنان چالشبرانگیز است. پیشرفتهای اخیر در مدلهای مولد، مانند DALL-E ۳ و Stable Diffusion، تصاویر را بهقدری واقعی کرده که حتی کارشناسان هم گاهی فریب میخورند.

واترمارکگذاری، که بهعنوان راهحلی برای شناسایی تصاویر مصنوعی پیشنهاد شده بود، به دلیل امکان حذف یا دستکاری، غیرقابلاعتماد است. علاوه بر این، جستوجوی معکوس تصویر ممکن است نتایج گمراهکنندهای بدهد، بهویژه اگر هوش مصنوعی از تصاویر واقعی بهعنوان مرجع استفاده کرده باشد.

یکی دیگر از چالشها، سرعت تولید این تصاویر است. درحالیکه خلق یک تصویر جعلی تنها چند ثانیه طول میکشد، بررسی و تأیید اعتبار آن میتواند زمانبر باشد. این عدم تعادل به تصاویر جعلی اجازه میدهد بهسرعت در شبکههای اجتماعی پخش شوند و قبل از شناسایی، آسیبهای قابلتوجهی ایجاد کنند.

پیامدهای اجتماعی و نیاز به سواد رسانهای

ناتوانی در تشخیص تصاویر تولیدشده توسط هوش مصنوعی پیامدهای گستردهای دارد. از گسترش اطلاعات نادرست در انتخابات و بحرانهای جهانی تا آسیبهای شخصی ناشی از دیپفیکهای غیراخلاقی، این فناوری میتواند اعتماد عمومی را به رسانهها و تصاویر بصری تضعیف کند. مثال زلزله کاسکادیا نشان داد که چگونه یک داستان جعلی میتواند بهسرعت باور عمومی را شکل دهد، بهویژه در محیطهای دیجیتال که بررسی انتقادی اغلب نادیده گرفته میشود.

برای مقابله با این تهدید، تقویت سواد رسانهای ضروری است. آموزش کاربران برای پرسیدن سؤالاتی مانند «این تصویر از کجا آمده؟» یا «آیا جزئیات آن منطقی است؟» میتواند به کاهش تأثیر محتوای جعلی کمک کند. همچنین، توسعه ابزارهای تشخیص خودکار، اگرچه هنوز در مراحل اولیه است، میتواند مکمل تلاشهای انسانی باشد.

انتهای پیام

نظرات